Пойдёте ли вы работать в компанию, которая запрещает ИИ-инструменты?

Автор: Евгений Падежнов

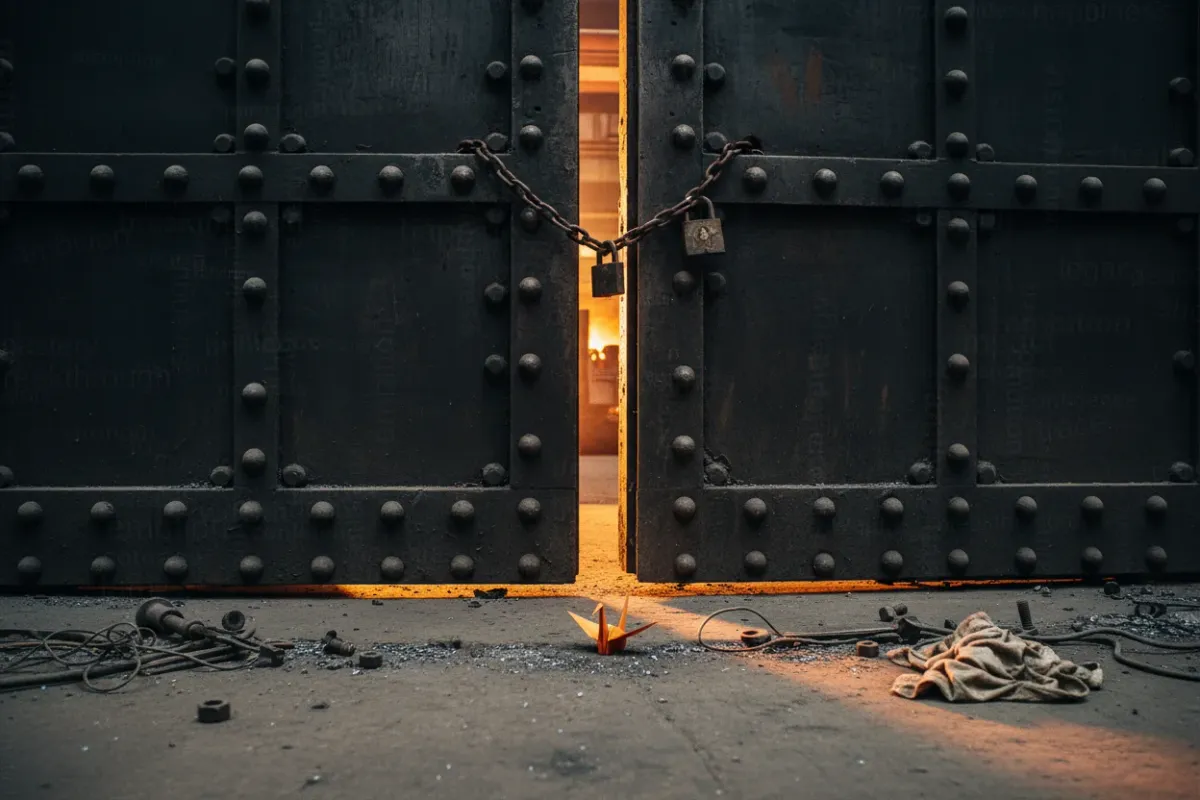

В вакансии написано: «ИИ-инструменты запрещены». Для всё большего числа специалистов это повод отказаться сразу.

Вопрос уже не теоретический. Согласно отчёту LayerX за 2025 год, 45% сотрудников уже используют те или иные инструменты генеративного ИИ на работе. Запрет ИИ — это не вопрос политики. Это вопрос кадров.

Цифры, стоящие за переменами

Кривая внедрения крутая и зависит от отрасли. Глобальный опрос McKinsey, проведённый в конце 2024 года, показал, что 71% организаций используют генеративный ИИ хотя бы в одной бизнес-функции. В сфере технологий эта цифра достигает 88%. Профессиональные услуги: 80%. Даже здравоохранение — 63%.

На ChatGPT приходится 92% корпоративного использования генеративного ИИ, за ним следуют Gemini с 15% и Claude с 5%.

Ключевой момент: запрет ИИ-инструментов не останавливает их использование. Исследование KPMG и Мельбурнского университета, охватившее 48 340 участников из 47 стран, показало, что 57% сотрудников признаются, что скрывали использование ИИ-инструментов на работе. Запрет создаёт теневые ИТ, а не соблюдение правил.

Что происходит, когда компании ограничивают ИИ

Опрос BCG «ИИ на рабочем месте» за 2025 год, охвативший более 10 600 работников из 11 стран, выявил прямую закономерность: когда у сотрудников нет доступа к одобренным ИИ-инструментам, более половины заявили, что найдут альтернативы и всё равно будут ими пользоваться. Результат — фрагментация, риски безопасности и разочарованные сотрудники.

Простыми словами: компания, запрещающая ИИ, получает не свободную от ИИ рабочую силу. Она получает неуправляемую.

Тот же опрос BCG показал, что поддержка руководства меняет всё. Доля сотрудников, положительно относящихся к генеративному ИИ, возрастает с 15% до 55%, когда руководители активно поддерживают внедрение. Лишь около четверти рядовых сотрудников в настоящее время получают такую поддержку.

Распространённая ошибка: рассматривать политику в отношении ИИ как бинарный выбор — разрешить всё или запретить всё. Золотая середина — это структурированное управление. Анализ Littler рекомендует определить одобренные инструменты, обозначить допустимые задачи и проводить периодические аудиты. FordHarrison советует разработать базовые политические рекомендации, которые ограничивают ввод конфиденциальных данных, но допускают продуктивное использование.

Сигнал для рынка талантов

Глобальный опрос PwC «Надежды и страхи рабочей силы» за 2025 год показывает, что 70% ежедневных пользователей генеративного ИИ ожидают значительного влияния технологии на рабочие места. Это самые вовлечённые и дальновидные работники. Почти треть сотрудников начального уровня выражают обеспокоенность влиянием ИИ на их будущее, но при этом 47% также проявляют любопытство, а 38% — оптимизм.

Проверено на практике: разработчики, которые используют инструменты для написания кода с помощью ИИ — Copilot, Cursor, Claude — вырабатывают мышечную память вокруг этих рабочих процессов. Просить их остановиться — всё равно что просить плотника оставить дома электродрель. Работать они смогут. Просто не захотят.

Согласно опросу Beautiful.ai среди 3 000 менеджеров, лишь 7% назвали результаты ИИ лучшими по сравнению с результатами людей — это на 15% меньше, чем в 2024 году. Сдвиг значительный. Менеджеры больше не видят в ИИ замену. Они видят в нём партнёра для совместной работы — для автоматизации рутинных задач и ускорения мозговых штурмов.

Половина опрошенных менеджеров предвидят, что ИИ заменит элементы их рабочих функций — и воспринимают это положительно. Не как угрозу. Как повышение продуктивности.

Обоснованные причины для ограничений (и как сделать это правильно)

Не каждое ограничение иррационально. Регулируемые отрасли сталкиваются с реальными требованиями комплаенса. ИИ-инструменты, используемые при найме, продвижении или дисциплинарных взысканиях, могут создавать юридические риски в рамках законов о дискриминации в сфере занятости. Модели-«чёрные ящики» затрудняют обоснование законных причин для неблагоприятных кадровых решений.

Опрос юридической фирмы показал, что 24% менеджеров, использующих ИИ для управления персоналом, вообще не проходили обучение этичному использованию. Большинство полагались на универсальные чат-боты, а не на специализированные инструменты.

Решение — не тотальный запрет. А управление:

- Определите, какие инструменты одобрены и для каких задач

- Ограничьте вводимые данные — никаких персональных данных сотрудников, никакой конфиденциальной деловой информации в универсальных чат-ботах

- Требуйте проверки человеком, прежде чем результаты работы ИИ будут использованы для принятия решений

- Обучайте менеджеров этичному использованию, а не только функциям

- Проводите периодические аудиты и обновляйте политики по мере развития инструментов

Карьерный расчёт

Для рядовых специалистов — особенно в сфере технологий, дизайна и контента — расчёт прост. Компания, запрещающая ИИ-инструменты, сигнализирует об одном из трёх:

- Опасения по поводу безопасности без плана действий. Понятно в краткосрочной перспективе. Тревожный знак, если ситуация сохраняется более шести месяцев без формирования системы управления.

- Оторванность руководства. Лица, принимающие решения, не понимают, что делают эти инструменты. Ожидайте аналогичных пробелов и в других областях.

- Культурная ригидность. Если работает — значит, правильно. Организации, отвергающие доказанные преимущества в продуктивности, как правило, отстают и в других отношениях.

Ни один из этих пунктов не является автоматически дисквалифицирующим. Но каждый стоит того, чтобы задать вопросы на собеседовании.

Попробуйте: задайте потенциальному работодателю три вопроса. Какие ИИ-инструменты одобрены? Какова процедура запроса на использование новых? Когда политика обновлялась в последний раз? Ответы расскажут о корпоративной культуре больше, чем любая миссия компании.

Часто задаваемые вопросы

Как организации могут определить, действительно ли ИИ-инструмент устраняет рабочие трудности, или это просто внедрение «сверху»?

Начните с рабочих процессов, которые вызывают больше всего жалоб. Определите, где сотрудники тратят время на повторяющиеся задачи, не требующие глубокого анализа. Если ИИ-инструмент не снижает трение именно в этих точках — это показуха, а не стратегия.

Как отличить сотрудника, который действительно испытывает трудности с новым инструментом, от того, кто использует сопротивление как предлог?

Отслеживайте показатели производительности до и после внедрения. Обеспечьте достаточное обучение — опрос BCG показывает, что одна только поддержка руководства повышает положительное отношение с 15% до 55%. Сотрудники, испытывающие трудности, улучшают результаты при поддержке. Сопротивляющиеся сотрудники вообще не взаимодействуют с обучением.

Если ИИ-инструмент создаёт барьеры для работников с ограниченными возможностями, какие разумные приспособления обязан предоставить работодатель?

Законы о дискриминации в сфере занятости — включая ADA — применяются к процессам с использованием ИИ. Работодатели обязаны обеспечить, чтобы ИИ-инструменты не создавали непропорционального негативного воздействия, и должны предоставлять разумные приспособления. Контракты с поставщиками должны включать требования к доступности и положения об объяснимости.

Информация актуальна на момент публикации. Условия, цены и правила могут измениться — уточняйте у профильных специалистов.